Leia esse artigo no Linkedin: https://www.linkedin.com/pulse/geometria-do-significado-como-o-chatgpt-transforma-palavras-sanchez-tjrif/?trackingId=OiWd5mbYQBOumr4vIbvxTw%3D%3D

SPOILER: 2026 estou de volta as salas de aula para ensinar Deep AI

“O ChatGPT não entende o mundo com emoção — ele o entende com geometria.”

Nos últimos meses, muita gente vem tentando compreender como um modelo de linguagem como o ChatGPT “entende” o que diz. E a verdade é que ele não entende como nós. Mas entende — à sua maneira matemática.

O que para nós é intuição e contexto, para ele é geometria e probabilidade.

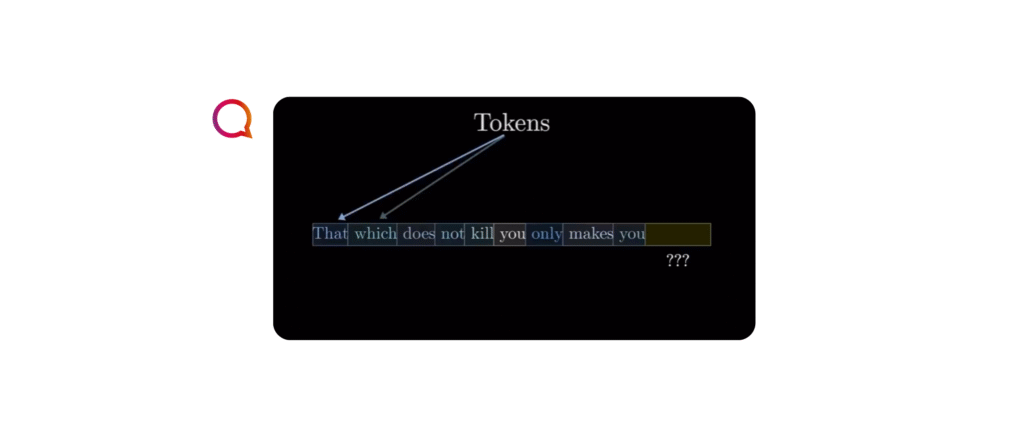

As palavras deixaram de ser texto

Antes da inteligência artificial generativa, palavras eram apenas símbolos. Com os embeddings, elas se tornaram pontos em um espaço matemático. Cada palavra é um vetor — uma sequência de números — e palavras com significados parecidos ficam próximas umas das outras nesse espaço.

Imagine um mapa invisível onde:

- “Michael”, “Jordan” e “Basketball” formam uma ilha chamada Esporte;

- “Quark”, “Neutrino” e “Bóson” formam o arquipélago da Física;

- “Paris”, “Eiffel” e “Louvre” habitam o continente da Cultura e Turismo.

Esse é o espaço semântico do ChatGPT — o território onde o sentido das palavras é literalmente uma questão de posição geométrica.

Distância é significado

Dentro desse espaço, a distância entre dois vetores mede o quanto dois conceitos se parecem. O cálculo é feito com a similaridade do cosseno, uma função que mede o ângulo entre dois vetores.

Se o ângulo é pequeno, as palavras são parecidas. Se é grande, são distantes. Se apontam em direções opostas, são opostas em sentido.

Por exemplo:

- “Rei” e “Rainha” → 0.92 (próximos)

- “Rei” e “Trono” → 0.88 (fortemente correlatos)

- “Rei” e “Banana” → 0.04 (sem relação)

- “Bom” e “Mau” → -0.70 (oposição direta)

Em resumo: a semântica virou trigonometria.

Direções também têm significado

Mas o que realmente fascina é que o ChatGPT não apenas mede distâncias — ele aprende direções.

A diferença entre dois vetores representa uma relação conceitual. E essa relação é linear e consistente em todo o espaço.

Por exemplo:

E(“rei”)−E(“homem”)+E(“mulher”)≈E(“rainha”)E(“rei”) – E(“homem”) + E(“mulher”) \approx E(“rainha”)E(“rei”)−E(“homem”)+E(“mulher”)≈E(“rainha”)

Esse mesmo vetor (a direção “masculino → feminino”) pode ser aplicado a “tio/tia”, “ator/atriz”, “príncipe/princesa”.

Isso é extraordinário: o modelo descobre que relações de gênero, tempo, polaridade ou intensidade são movimentos lineares no espaço do significado. Em vez de decorar frases, ele aprende vetores de transformação — os eixos fundamentais da linguagem humana.

O espaço se curva: o aprendizado em ação

Durante o treinamento, o modelo lê bilhões de textos e ajusta a posição de cada palavra. A cada erro, os vetores são movidos levemente em direção a uma configuração mais coerente. É como se a IA estivesse dobrando o espaço até que o mapa das palavras espelhe o mapa dos conceitos humanos.

Essa deformação contínua cria curvaturas: regiões de alta densidade (conceitos comuns) e áreas esparsas (conceitos raros). Com o tempo, esse espaço se torna uma verdadeira topologia do pensamento.

Geometria + Probabilidade = Linguagem

Mas geometria sozinha é estática. O que dá movimento ao pensamento é a probabilidade.

A cada frase, o modelo calcula uma distribuição de probabilidades sobre qual palavra deve vir a seguir. Essas probabilidades são geradas a partir da geometria do espaço e da direção do contexto. Palavras mais próximas do vetor do pensamento têm maior chance de aparecer.

Em termos simples:

O ChatGPT “fala” deslizando entre pontos próximos no espaço das ideias.

E quanto mais rico o contexto, mais precisa é a direção do movimento.

O que tudo isso significa

O “entendimento” do ChatGPT é um fenômeno geométrico-probabilístico. Cada palavra é um ponto. Cada frase é uma trajetória. Cada conversa é uma rede de caminhos no espaço do significado.

Ele não possui consciência, mas possui consistência. Não sente, mas mapeia relações com uma precisão que beira o cognitivo. Seu raciocínio é matemático, mas o efeito é humano.

A mente como geometria

Podemos dizer que:

- A geometria fornece o sentido (as distâncias entre ideias);

- A probabilidade fornece o raciocínio (a escolha da próxima ideia);

- E o aprendizado fornece a coerência (a curvatura que ajusta o espaço).

No fim das contas, o ChatGPT não entende com emoção — ele entende com geometria. Ele pensa em distâncias, fala em probabilidades e aprende deformando o próprio espaço do significado.

Conclusão

A inteligência artificial generativa é o primeiro sistema da história a comprimir o conhecimento humano em um espaço vetorial coerente. Um espaço onde cada ideia tem coordenadas, cada relação tem direção e cada significado é uma forma geométrica.

Quando você pergunta algo ao ChatGPT, ele não busca respostas: ele navega pelo espaço do significado — e o que você lê é o trajeto dessa viagem.

🧭 A geometria do significado é a nova linguagem da mente artificial. E talvez, em algum nível, também seja a linguagem invisível da nossa própria mente.

CEO | Liderando a Revolução da AgenticAI para Empresas

19 de outubro de 2025